Conceptos de Hardware y Software

Representación de datos

Para

entender la manera en que las computadoras procesan datos, es importante

conocer cómo la computadora representa los datos. Las personas se comunican a

través del habla combinando palabras en oraciones. El habla humana es análoga

porque utiliza señales continuas que varían en fortaleza y calidad. Las

computadoras son digitales, pues reconocen solo dos estados: encendido (on) y

apagado (off). Esto es así porque las computadoras son equipos electrónicos que

utilizan electricidad, que también tiene solo dos estados: on y off. Los dos

dígitos 0 y 1 pueden fácilmente representar estos dos estados. El dígito cero

representa el estado electrónico apagado (la ausencia de carga electrónica). El

dígito uno representa el estado electrónico encendido (presencia de carga

electrónica).

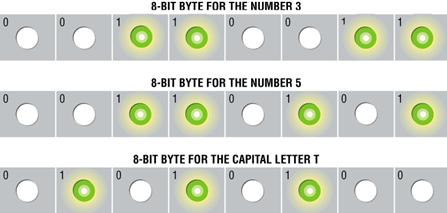

El sistema binario es un sistema

numérico que tiene tan solo dos dígitos, 0 y 1, llamados bits. Un bit (binary

digit) es la unidad de datos más pequeña que la computadora puede

representar. Por sí solo, un bit no es muy informativo. Cuando ocho bits se

agrupan como una unidad, forman un byte. El byte es informativo porque provee

suficientes combinaciones diferentes de 0 y 1 para representar 256 caracteres

individuales. Esos caracteres incluyen números, letras mayúsculas y minúsculas,

signos de puntuación y otros.

El sistema binario es un sistema

numérico que tiene tan solo dos dígitos, 0 y 1, llamados bits. Un bit (binary

digit) es la unidad de datos más pequeña que la computadora puede

representar. Por sí solo, un bit no es muy informativo. Cuando ocho bits se

agrupan como una unidad, forman un byte. El byte es informativo porque provee

suficientes combinaciones diferentes de 0 y 1 para representar 256 caracteres

individuales. Esos caracteres incluyen números, letras mayúsculas y minúsculas,

signos de puntuación y otros.

Las combinaciones de 0 y 1 que

representan caracteres son definidas por patrones llamados esquemas de códigos

(coding scheme). Esquemas de códigos populares son:

1.

ASCII – American Standard Code for Information

Interchange – es el sistema de código para representar datos que más se

utiliza. La mayoría de las computadoras personales y servidores mid-range

utilizan el esquema de código ASCII.

2.

EBCDIC – Extended Binary Coded Decimal Interchange Code –

es utilizado principalmente en computadoras mainframe.

3.

Unicode – es el único esquema de código capaz de

representar todos los lenguajes del mundo actual. Se desarrolló precisamente

porque el ASCII y el EBCDIC no eran suficientes para representar lenguajes para

alfabetos diferentes al inglés o Europeo, como los asiáticos y otros.